Философия искусственного интеллекта

Содержание:

- Введение

- Отличие искусственного интеллекта от естественного

- Как работает Object Tracking на YOLO и DeepSort

- Экономический эффект и влияние на рынок труда

- Национальная концепция развития

- Четвертая революция

- Может ли машина чувствовать?

- Разработка AI-продукта на основе машинного зрения. Промежуточная ретроспектива: мысли, боль, страдания

- Личность ли искусственный интеллект?

- Что такое искусственный интеллект?

- Что такое «предвзятость ИИ»?

- Рынок технологий искусственного интеллекта

- Этические проблемы создания искусственного разума

- Текущее состояние дел

Введение

Традиционно показателем общей успешности в области разработки систем искусственного интеллекта считается способность внешне смоделировать типичные человеческие функции, качества и свойства, тем самым превзойдя человека в типично человеческих видах деятельности. Проявления и «самореализация» разработанных образцов воспринимаются сквозь призму человеческого фактора и так называемого «эффекта ИИ» (обессмысливание и «депсихологизация» деятельности), что являет собой латентную, но, тем не менее, глобальную проблему данной сферы. Проблема особенно актуализируется в связи с отсутствием критериев интерпретирования и «понимания» того, что мы имеем в качестве результатов деятельности в области разработки искусственного интеллекта: сугубо алгоритмизированный, лишённый возможностей понимания и осмысления механизм, или же – психо-машину с потенциалом возникновения прото-психических качеств, то есть задатков психики и, возможно, интеллекта. Несмотря на терминологические особенности самого понятия «искусственный интеллект», в мировом научном сообществе принято считать, что наличие именно сознания, а не интеллекта станет необходимым и достаточным основанием для признания машины разумной .

Если рассмотреть динамику своеобразной оппозиции организм-механизм (человек-машина), очевидным станет всеобщее признание превосходства первого над вторым: за организмом признается безусловное наличие сознательных качеств. Механизм остается вторичным, производным от организма. И неизвестно, что должно на самом деле произойти, для того чтобы механизм заслужил признание организма. Парадигма междисциплинарности в данном случае только усложняет проблему.

Детерминантой возникновения подобного восприятия машинной деятельности является совокупность двух векторов общечеловеческого нарциссизма, один из которых не позволяет организму признавать что-либо иное, кроме себя, в качестве достойного для обладания высшими привилегиями. Данный подход существенно затрудняет интерпретирование достижений техногенеза. Другой вектор – техно-дискриминация, т. е. гипертрофированный антропный принцип в виде постулата «долженствования»: механизм «должен» служить человеку и заменять его в наиболее сложных, небезопасных, монотонных областях деятельности.

Литература:

1. Скиба И.Р. Проблема искусственного интеллекта: человек и машина https://neuronus. com/stat/1392-problema-iskusstvennogo-intellekta-chelovek-i-mashina.html

Отличие искусственного интеллекта от естественного

Интеллект можно определить как общую умственную способность к рассуждению, решению проблем и обучению

В силу своей общей природы интеллект интегрирует когнитивные функции, такие как восприятие, внимание, память, язык или планирование. естественный интеллект отличает осознанное отношение к миру

Мышление человека всегда эмоционально окрашено, и его нельзя отделить от телесности. Кроме того, человек — существо социальное, поэтому на мышление всегда влияет социум. ИИ не имеет отношения к эмоциональной сфере и социально не ориентирован.

Как сравнить человеческий и компьютерный интеллекты?

Сравнить мышление человека с искусственным интеллектом можно исходя из нескольких общих параметров организации мозга и машины. Деятельность компьютера, как и мозга, включает четыре этапа: кодирование, хранение, анализ данных и выдачу результата. Кроме того, мозг человека и ИИ могут самообучаться в зависимости от данных, полученных из окружающей среды. Также человеческий мозг и машинный интеллект решают проблемы (или задачи), используя определенные алгоритмы.

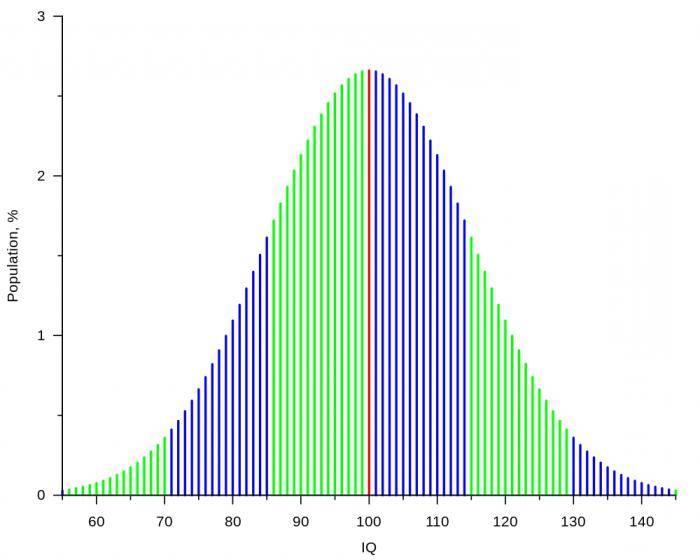

У компьютерных программ есть IQ?

Нет. Показатель IQ связан с развитием интеллекта человека в зависимости от возраста. ИИ в чем-то превышает некоторые человеческие способности, например может удерживать в памяти огромное количество цифр, но это не имеет отношения к IQ.

Что такое тест Тьюринга?

Алан Тьюринг разработал эмпирический тест, который показывает, способна ли программа уловить все нюансы поведения человека до такой степени, что человек не сможет определить, с кем именно он общается — с ИИ или с живым собеседником. Тьюринг предложил, чтобы сторонний наблюдатель оценивал разговор между человеком и машиной, которая отвечает на вопросы. Судья не видит, кто именно отвечает, но знает, что один из собеседников — ИИ. Разговор ограничен только текстовым каналом (компьютерная клавиатура и экран), поэтому результат не зависит от способности машины отображать слова как человеческую речь. В случае, если программе удается обмануть человека, считается, что она эффективно справилась с тестом.

Символьный подход

Символьный подход к ИИ — совокупность всех методов исследования искусственного интеллекта, основанных на высокоуровневых символических (читаемых человеком) представлениях о задачах, логике и поиске. Символьный подход широко применялся в исследованиях ИИ в 1950–80-х годах. Одной из популярных форм символьного подхода являются экспертные системы, использующие сочетание определенных правил производства. Производственные правила связывают символы в логические связи, которые подобны алгоритму If-Then. Экспертная система обрабатывает правила, чтобы сделать выводы и определить, какая дополнительная информация ей нужна, то есть какие вопросы задавать, используя удобочитаемые символы.

Логический подход

Термин «логический подход» предполагает апеллирование к логике, размышлениям, решению задач с помощью логических шагов. Логики еще в XIX веке разработали точные обозначения для всех видов объектов в мире и отношений между ними. К 1965 году существовали программы, которые могли решить любую логическую задачу (пик популярности данного подхода пришелся на конец 1950–70-х годов). Сторонники логического подхода в рамках логического искусственного интеллекта надеялись выстроить на таких программах (в частности, записанных на языке Prolog) интеллектуальные системы. Однако у такого подхода два ограничения. Во-первых, нелегко взять неформальное знание и изложить его в формальных терминах, которые требуются для обработки ИИ. Во-вторых, есть большая разница между решением проблемы в теории и ее решением на практике. Даже проблемы с несколькими сотнями фактов могут исчерпать вычислительные ресурсы любого компьютера, если у него нет каких-либо указаний относительно того, какие рассуждения надо использовать в первую очередь.

Агентно-ориентированный подход

Агент — это то, что действует (от лат. agere, «делать»). Конечно, все компьютерные программы что-то делают, но ожидается, что компьютерные агенты будут делать больше: работать автономно, воспринимать сигналы окружающей среды (с помощью специальных датчиков), адаптироваться к изменениям, создавать цели и выполнять их. Рациональный агент — это тот, кто действует так, чтобы достичь наилучшего ожидаемого результата.

Гибридный подход

Предполагается, что этот подход, который стал популярным в конце 80-х, работает наиболее эффективно, так как представляет собой сочетание символьных и нейронных моделей. Гибридный подход увеличивает когнитивные и вычислительные возможности машины.

Как работает Object Tracking на YOLO и DeepSort

Object Tracking — очень интересное направление, которое изучается и эволюционирует не первый десяток лет. Сейчас многие разработки в этой области построены на глубоком обучении, которое имеет преимущество над стандартными алгоритмами, так как нейронные сети могут аппроксимировать функции зачастую лучше.

Но как именно работает Object Tracking? Есть множество Deep Learning решений для этой задачи, и сегодня я хочу рассказать о распространенном решении и о математике, которая стоит за ним.

Итак, в этой статье я попробую простыми словами и формулами рассказать про:

- YOLO — отличный object detector

- Фильтры Калмана

- Расстояние Махаланобиса

- Deep SORT

Экономический эффект и влияние на рынок труда

Научная фантастика и Голливуд сформировали представление об «искусственном интеллекте» как о следующей форме жизни на планете, которая поработит человечество в Матрице или организует ему ядерный Судный день. Выживших добьет Терминатор.

Image caption

Умрет ли человечество от Skynet?

В действительности, несмотря на последние достижения в области искусственного интеллекта, до появления разумных машиносуществ еще далеко, признают ученые и специалисты

И те, и другие, впрочем, советуют на некоторые аспекты обратить внимание уже сейчас

По оценкам исследовательской организации McKinsey Global Institute, в ближайшие десять лет новые технологии радикально изменят рынок труда на планете, что позволит сэкономить порядка 50 трлн долларов.

Изменения коснутся сотен миллионов рабочих мест. Люди все больше и больше будут перекладывать часть своих служебных заданий и многие рутинные задачи на машину, что позволит им сосредоточиться на творческой работе.

«С некоторой точки зрения у человечества в целом есть важная и интересная задача — развиваться каждому конкретному индивидууму гораздо быстрее, чем человечество развивает системы искусственного интеллекта», — считает эксперт, директор по распространению технологий «Яндекса» Григорий Бакунов.

Но вместе с автоматизацией неминуемо пострадают менее квалифицированные кадры, и уже сейчас необходимо задуматься, как их защитить, переучить и подготовить к новой жизни.

Пострадать, как показывает практика, могут не только синие воротнички, но и работники умственного труда. Несколько дней назад Goldman Sachs заменил команду из 600 трейдеров на двух человек и автоматизированные программы алгоритмического трейдинга, для обслуживания которых были наняты 200 разработчиков-программистов.

Image caption

Многие задачи вскоре станут по силам роботизированным системам, которые последовательно начнут заменять людей

Искусственный интеллект сам по себе не тождественен автоматизации процессов, но развитие ИИ приведет к тому, что все больше задач будет по силам компьютерной программе.

Среди вариантов решения проблемы вытеснения человека машиной на рынке труда, как указывает Аллисон Дютман, координатор программ Foresight Institute — некоммерческой организации, базирующейся в Силиконовой долине для продвижения новых технологий, — введение понятия «универсальный базовый доход», который бы получал каждый житель вне зависимости от уровня дохода и занятости. Подобный доход финансировался бы за счет так называемого инновационного налога Land Value Tax, введение которого сейчас активно обсуждается в Силиконовой долине.

Национальная концепция развития

Национальные стратегии развития ИИ уже утвердили три десятка стран. В октябре 2019 года проект Национальной стратегии развития ИИ должен быть принят в России. Предполагается, что в Москве будет введен правовой режим, облегчающий разработку и внедрение технологий ИИ.

Исследования в сфере ИИ

Вопросы, что такое искусственный интеллект и как он работает, волнуют ученых разных стран уже не одно десятилетие. Госбюджет США ежегодно направляет 200 млн долларов на исследования. В России за 10 лет — с 2007-го по 2017-й — было выделено около 23 млрд рублей

Разделы по поддержке исследований в сфере ИИ станут важной частью концепции национальной стратегии. В скором времени в России откроются новые научные центры, а также будет продолжена разработка инновационного ПО для ИИ

Стандартизация в области ИИ

Нормы и правила в области ИИ в России находятся в процессе постоянной доработки. Предполагается, что в конце 2019 — начале 2020 года будут утверждены национальные стандарты, которые сейчас разрабатывают лидеры рынка. Параллельно формируется План национальной стандартизации на 2020 год и далее. В мире работает стандарт «Искусственный интеллект. Концепция и терминология», и в 2019 году эксперты начали разрабатывать его русифицированную версию. Документ должен быть утвержден в 2021 году.

Четвертая революция

Как бы мы ни относились к искусственному интеллекту, придется принять тот факт, что он уже существует. Отказаться от него — значит сделать шаг назад в развитии. Ведь ИИ — это важная часть нашего прогресса. Многие ученые связывают с искусственными нейросетями начало четвертой промышленной революции и заявляют о том, что грядет новая эпоха — когда рядом с нами появится рукотворный разум, всегда готовый прийти на помощь.

Все новое пугает и вызывает недоверие — это нормальная человеческая реакция, и многие люди с опаской относятся к ИИ. Про ужасы, которые принесет нам искусственный разум, не говорил разве что ленивый фантаст. Но подобное в свое время сочиняли о каждом технологическом новшестве. Люди боялись паровозов, потому что они «распугают коров, отравят птиц дымом, а при скорости свыше 15 миль в час пассажиров разорвет на части». Вероятно, потомки тоже будут посмеиваться над нашими страхами, о которых узнают из фильмов и книг XX и XXI веков.

Может ли машина чувствовать?

Философия искусственного интеллекта началась с вопроса, могут ли машины мыслить. Однако сегодня киберфилософов (да и разработчиков) больше интересует, способен ли робот испытывать эмоции и как его этому научить. И хотя мы привыкли думать, что разного рода переживания затрудняют мышление (а если так, то зачем они нужны искусственному интеллекту?), исследования в области нейронаук показали, что дела обстоят несколько иначе.

В 1990-х нейробиолог Антонио Дамасио описал историю пациента Эллиота, у которого обнаружили опухоль в мозгу. Операция прошла успешно, но никто не ожидал, что она даст такой странный побочный эффект: больной перестал испытывать какие-либо эмоции.

Источник

С тех пор ученые всё глубже исследуют связь эмоций с интеллектом и понимают, что одно не существует без другого

Оказалось, что от наших переживаний больше пользы, чем вреда: они нас мотивируют и помогают без долгих размышлений и поиска аргументов за и против принимать решения в ситуациях выбора, что важно для выживания организма. Благодаря эмоциям мы реагируем быстрее и действуем эффективнее

Пока нам до этого далеко. Но мы учим искусственный интеллект распознавать человеческие эмоции, а также их имитировать. Например, вы можете накричать на Сири или сказать ей что-то обидное — и она ответит вам, что оскорблена или расстроена (в интернете даже можно найти инструкцию, как вывести электронную помощницу из себя).

Разработчики современных роботов стремятся к тому, чтобы они не только выглядели, но и вели себя как люди — хотя каждый из нас понимает, что они не мы.

Однако не все исследователи искусственного интеллекта поддерживают такой подход. Есть и те, кто опасается, что отношения с ИИ, который лишь притворяется, что испытывает какие-либо эмоции, могут сбить нас с толку и даже нанести психологическую травму.

Разработка AI-продукта на основе машинного зрения. Промежуточная ретроспектива: мысли, боль, страдания

Здравствуйте, читатели. Я порывался написать эту статью уже несколько раз, но каждый раз откладывал, поскольку, при мысли о необходимости провести глубокую рефлексию по накопленному опыту, меня накрывало уныние и печаль. Однако, я укрепился в своем намерении сделать это, чтобы поделиться опытом с теми из вас, кто планирует заняться чем-то подобным в сфере AI. Все нижеописанное относится к весьма конкретной сфере деятельности: AI в части компьютерного зрения.

Disclaimer: Я не специалист в нейросетях, но выполняю роль владельца продукта, в котором ключевую роль занимают нейросетевые модели компьютерного зрения. Эта статья для тех, кто вынужден делать такую же работу, а так же для тех специалистов ML, которые хотят понять, как на их деятельность смотрят люди со стороны бизнеса.

Личность ли искусственный интеллект?

Является ли роботизированная система личностью? Может ли умный компьютер голосовать? Какого он пола? Отношения человека и умной машины уже сейчас обсуждают депутаты Европарламента, задаваясь вопросом, следует ли наделять будущих роботом статусом «электронной личности».

Как указывает Дютман, люди нехотя делятся правами с теми, кто им непонятен, а значит будут сопротивляться «очеловечиванию» ИИ.

Image caption

Человека и машину разделяет главное — способность думать

«Принимая во внимание, как долго человечество шло к тому, чтобы наделить равными правами всех людей, вне зависимости от цвета их кожи, расы или гендера, можно уже сейчас предположить, что и машины они не сходу не признают равными. Вместе с этическими появляются и юридические тонкости: кто возьмет на себя ответственность в случае аварии беспилотного автомобиля или поломки умного медицинского устройства — и нравственные вопросы: стоит ли развивать беспилотное оружие, способное действовать без ведома человека?

Вместе с этическими появляются и юридические тонкости: кто возьмет на себя ответственность в случае аварии беспилотного автомобиля или поломки умного медицинского устройства — и нравственные вопросы: стоит ли развивать беспилотное оружие, способное действовать без ведома человека?

Третья этическая головоломка обсуждается чаще других и волнует человечество гораздо больше: что теоретически может сделать с человечеством суперинтеллект, настоящая умная машина?

Что такое искусственный интеллект?

Описание искусственного нейрона

Искусственный нейрон — это математическая функция, задуманная как модель биологических нейронов, нейронной сети. Искусственные нейроны — элементарные единицы в искусственных нейросетях. Искусственный нейрон получает один или несколько входов и суммирует их, чтобы произвести выход или активацию, представляющую потенциал действия нейрона, который передается вдоль его аксона. Обычно каждый вход анализируется отдельно, и сумма передается через нелинейную функцию, известную как функция активации, или передаточная функция.

Когда началось исследование ИИ?

В 1935 году британский исследователь А.М. Тьюринг описал абстрактную вычислительную машину, которая состоит из безграничной памяти и сканера, перемещающегося вперед и назад по памяти, символ за символом. Сканер считывает то, что он находит, записывая дальнейшие символы. Действия сканера диктуются программой инструкций, которая также хранится в памяти в виде символов. Самая ранняя успешная программа ИИ была написана в 1951 году Кристофером Стрейчи. В 1952 году эта программа могла играть с человеком в шашки, удивляя всех своими способностями предсказывать ходы. В 1953 году Тьюринг опубликовал классическую раннюю статью о шахматном программировании.

Что такое «предвзятость ИИ»?

Где-то до 2013 года, чтобы сделать систему, которая, скажем, распознает котов на фотографиях, вам надо было описывать логические шаги. Как найти на изображении углы, распознать глаза, проанализировать текстуры на наличие меха, посчитать лапы, и так далее. Затем собрать все компоненты — и обнаружить, что это все толком не работает. Примерно как механическая лошадь — теоретически ее можно сделать, но на практике она слишком сложна для описания. На выходе у вас сотни (или даже тысячи) рукописных правил. И ни одной работающей модели.

С появлением машинного обучения мы перестали использовать «ручные» правила по распознаванию того или иного объекта. Вместо этого мы берем тысячу образцов «того», Х, тысячу образцов «иного», Y, и заставляем компьютер построить модель на основе их статистического анализа. Затем мы даем этой модели некоторый пример данных, и она с некой точностью определяет, подходит ли он к одному из наборов. Машинное обучение генерирует модель на основе данных, а не с помощью человека, который ее пишет. Результаты впечатляют, особенно в области распознавания изображений и паттернов, и именно поэтому вся тех индустрия сейчас переходит на машинное обучение (ML).

Но не все так просто. В реальном мире ваши тысячи примеров X или Y также содержат А, B, J, L, O, R и даже L. Они могут быть неравномерно распределены, и некоторые из них могут встречаться настолько часто, что система обратит на них больше внимания, чем на объекты, которые вас интересуют.

Что это значит на практике? Мой любимый пример — это когда системы распознавания изображений смотрят на травянистый холм и говорят: «овца»

Понятно, почему: большая часть фотографий-примеров «овцы» сделана на лугах, где они живут, и на этих изображениях трава занимает намного больше места, чем маленькие беленькие пушистики, и именно траву системы считают самой важной

Есть примеры и посерьёзнее. Из недавнего — один проект по обнаружению рака кожи на фотографиях. Оказалось, что дерматологи часто фотографируют линейку вместе с проявлениями рака кожи, чтобы зафиксировать размер образований. На примерах фотографий здоровой кожи линеек нет. Для системы ИИ такие линейки (точнее, пиксели, которые нами определяются как «линейка») стали одним из различий между наборами примеров, и иногда более важными, чем небольшая сыпь на коже. Так система, созданная для опознавания рака кожи, иногда вместо него опознавала линейки.

Ключевой момент здесь то, что у системы нет семантического понимания того, на что она смотрит. Мы смотрим на набор пикселей и видим в них овцу, кожу или линейки, а система — только числовую строку. Она не видит трехмерное пространство, не видит ни объектов, ни текстур, ни овец. Она просто видит паттерны в данных.

Сложность диагностики таких проблем в том, что нейронная сеть (модель, сгенерированная вашей системой машинного обучения) состоит из тысяч сотен тысяч узлов. Нет простого способа заглянуть в модель и увидеть, как она принимает решение. Наличие такого способа означало бы, что процесс достаточно прост, чтобы описать все правила вручную, без использования машинного обучения. Люди беспокоятся, что машинное обучение стало неким «черным ящиком». (Я объясню чуть позже, почему это сравнение все-таки перебор.)

Это, в общих словах, и есть проблема предвзятости искусственного интеллекта или машинного обучения: система для нахождения паттернов в данных может находить неверные паттерны, а вы можете этого не заметить. Это фундаментальная характеристика технологии, и это очевидно всем, кто работает с ней в научных кругах и в больших технологических компаниях. Но её последствия сложны, и наши возможные решения этих последствий — тоже.

Поговорим сначала о последствиях.

ИИ может неявно для нас делать выбор в пользу тех или иных категорий людей, основываясь на большом количестве незаметных сигналов

Рынок технологий искусственного интеллекта

Ожидается, что рынок к 2025 году вырастет до 190,61 млрд долларов, при ежегодном темпе прироста — 36,62%. На рост рынка влияют такие факторы, как внедрение облачных приложений и сервисов, появление больших массивов данных и активный спрос на интеллектуальных виртуальных помощников. Однако экспертов, разрабатывающих и внедряющих технологии ИИ, пока немного, и это сдерживает рост рынка. Системам, созданным на основе ИИ, необходима интеграция и техническая поддержка при обслуживании.

Процессоры для ИИ

Современные задачи ИИ требуют мощных процессоров, которые могут обрабатывать огромные массивы данных. Процессоры должны иметь доступ к большим объемам памяти, также устройству необходимы высокоскоростные каналы передачи данных.

В России

В конце 2018 года в России запустили серию серверов «Эльбрус-804», показывающих высокую производительность. Каждый из компьютеров оснащен четырьмя восьмиядерными процессорами. С помощью данных устройств можно выстроить вычислительные кластеры, они позволяют работать с приложениями и базами данных.

Драйверами и лидерами рынка являются две корпорации — Intel и AMD, производители самых мощных процессоров. Intel традиционно концентрируется на выпуске машин с более высокой тактовой частотой, AMD ориентирована на постоянное увеличение числа ядер и обеспечение многопоточной производительности.

Этические проблемы создания искусственного разума

Этот раздел содержит вопросы, касающиеся искусственного интеллекта и этики.

- Если в будущем машины смогут рассуждать, осознавать себя и иметь чувства, то что тогда делает человека человеком, а машину — машиной?

- Если в будущем машины смогут осознавать себя и иметь чувства, возможно ли будет их эксплуатировать или придется наделять их правами?

- Если в будущем машины смогут рассуждать, то как сложатся отношения людей и машин? Данный вопрос был не раз рассмотрен в произведениях искусства на примере противостояния людей и машин. К примеру, батлерианский джихад в романе «Дюна» Фрэнка Герберта, проблемы взаимоотношения с ИскИнами в романе Дэна Симмонса «Гиперион», война с машинами в кинофильме «Терминатор» и так далее.

- Будет ли человек, которому в результате многочисленных медицинских ампутаций заменили 99 процентов тела на искусственные органы, считаться машиной?

Данные вопросы рассматриваются в рамках философии техники и трансгуманистической философии.

Текущее состояние дел

Q-Learning

В чём недостатки?

- Модель плохо справляется с изменчивой реальностью. Если всю жизнь нас награждали за нажатие красной кнопки, а теперь наказывают, причём никаких видимых изменений не произошло… QL будет очень долго осваивать эту закономерность.

- Qn может быть очень непростой функцией. Например, для её расчёта надо прокрутить цикл из N итераций — и быстрее не выйдет. А прогнозная модель обычно имеет ограниченную сложность — даже у крупной нейросети есть предел сложности, а циклы крутить почти ни одна модель машинного обучения не умеет.

- У реальности обычно бывают скрытые переменные. Например, который сейчас час? Это легко узнать, если мы смотрим на часы, но как только мы отвели взгляд — это уже скрытая переменная. Чтобы учитывать эти ненаблюдаемые величины, нужно, чтобы модель учитывала не только текущее состояние, но и какую-то историю. В QL можно это сделать — например, подавать в нейронку-или-что-у-нас-там не только текущее S, но и несколько предыдущих. Так сделано в RL, который играет в игры Атари. Кроме того, можно использовать для прогноза рекуррентную нейросеть — пусть она пробежится последовательно по нескольким кадрам истории и рассчитает Qn.

Model-based системы

- Ресурсоёмкость. Допустим, на каждом такте нам нужно сделать выбор из двух альтернатив. Тогда за 10 тактов у нас соберётся 2^10=1024 возможных плана. Каждый план — это 10 запусков модели. У если мы управляем самолётом, у которого десятки управляющих органов? А реальность мы моделируем с периодом в 0.1 секунды? А горизонт планирования хотим иметь хотя бы пару минут? Нам придётся очень много раз запускать модель, выходит очень много процессорных тактов на одно решение. Даже если как-то оптимизировать перебор планов — всё равно вычислений на порядки больше, чем в QL.

- Проблема хаоса. Некоторые системы устроены так, что даже малая неточность симуляции на входе приводит к огромной погрешности на выходе. Чтобы этому противостоять, можно запускать несколько симуляций реальности — чуть-чуть разных. Они выдадут сильно различающиеся результаты, и по этому можно будет понять, что мы находимся в зоне такой вот неустойчивости.