Ультимативное сравнение embedded платформ для ai

Содержание:

- Introduction

- Перспективы применения автономных решений NVIDIA

- Start Building the Next Wave of Autonomous Machines Today

- Производительность Jetson Nano

- Notes:

- Vision Accelerator

- Installing TensorFlow

- Jetson Family

- Serial Console Background

- Возможно, вам также будет интересно

- Setup and First Boot

- Getting Started with the Jetson TX2 Developer Kit

- Сферы применения модулей семейства Jetson

- Prepare for Setup

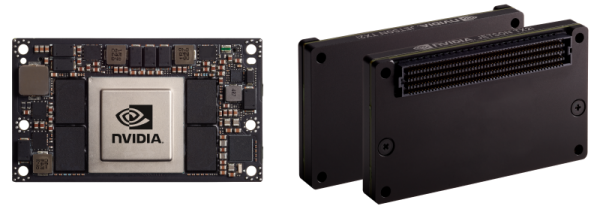

- Jetson TX2i Module

- Jetson TX2 Developer Kit

- Platform Documentation

- Guides and Tutorials

- Ecosystem Products

- Мобильники

- Technical Comparison

- Intelligent Video Analytics (IVA)

- RaspberryPI 4

- Преимущества платформы NVIDIA для ИИ

Introduction

The NVIDIA Jetson Nano Developer Kit is a small AI computer for makers, learners, and developers. After following along with this brief guide, you’ll be ready to start building practical AI applications, cool AI robots, and more.

- microSD card slot for main storage

- 40-pin expansion header

- Micro-USB port for 5V power input or for data

- Gigabit Ethernet port

- USB 3.0 ports (x4)

- HDMI output port

- DisplayPort connector

- DC Barrel jack for 5V power input

- MIPI CSI camera connectors

Included in the Box

Your Jetson Nano Developer Kit box includes:

- Jetson Nano Developer Kit

- Small paper card with quick start and support information

- Folded paper stand

Перспективы применения автономных решений NVIDIA

Универсальную платформу NVIDIA можно использовать в разнообразных отраслях: несмотря на то что сама компания в некоторых из них глубокой экспертизой не обладает, она предоставляет свой программный и аппаратный инструментарий для разработки подходящих устройств. Уже сейчас большое количество компаний разрабатывает готовые решения на модулях Jetson, подготавливает инструменты и библиотеки, занимается созданием программно-аппаратных комплексов на заказ.

Большинство из применений Jetson связано с видеоаналитикой, но ею дело не ограничивается. Перспективная сфера использования — промышленные дроны для инспекции строительных опор, трубопроводов, сложных технических сооружений и других конструкций. Раньше подобные устройства относились в основном к очень дорогим решениям за несколько тысяч долларов, но из-за бурного роста производительности современных процессоров, когда миниатюрные системы появились в продаже по сравнительно невысокой цене, стало возможным создание и недорогих устройств.

Start Building the Next Wave of Autonomous Machines Today

Jetson AGX Xavier brings game-changing levels of compute to robotics and edge devices, bringing high-end workstation performance to an embedded platform that’s been optimized for size, weight, and power. The production Jetson AGX Xavier compute module is now available globally through distribution, with volume pricing of $1,099 in quantities of 1000 units. Get started and become an NVIDIA Registered Developer today to take advantage of the $1,299 price for the Jetson AGX Xavier Developer Kit, including the ability to download and the latest JetPack software for Jetson AGX Xavier. You can also connect with other developers in the community on the DevTalk forums.

For a deep-dive on the Jetson AGX Xavier architecture, view our On-Demand webinar, Jetson AGX Xavier and the New Era of Autonomous Machines.

About the Authors

About Dustin Franklin

Dustin is a Developer Evangelist on the Jetson team at NVIDIA. With a background in robotics and embedded systems, Dustin enjoys helping out in the community and working on projects with Jetson. You can find him on Devtalk, GitHub, or LinkedIn.

View all posts by Dustin Franklin

Производительность Jetson Nano

Как можно увидеть на диаграмме (рис. 2), многие задачи инференса нейронных сетей на устройствах конкурентов или не работают совсем, или делают это со значительно меньшей производительностью. Очевидно, Jetson Nano подходит не для всех задач, но позволяет добавить элементы интеллектуальности к устройствам доступного ценового сегмента.

Рис. 2. Производительность Jetson Nano в задачах инференса нейронных сетей по сравнению с другими решениями

Это выгодно отличает Jetson Nano от попыток использования глубокого обучения на аналогичных компактных устройствах типа Raspberry Pi, даже с добавлением нейроускорителя от Intel. Решения семейства Jetson могут обеспечивать различные уровни производительности и энергопотребления в зависимости от требований. Они уже применяются в самых разных областях человеческой деятельности: медицине, авиации, производстве, строительстве, складах, магазинах и т. д. (рис. 3).

Рис. 3. Сферы применения модулей NVIDIA Jetson

Notes:

Make sure to update the eMMC

The copyImage.sh script copies the Image to the current device. If you are building the kernel on an external device, for example a SSD, you will probably want to copy the Image file over to the eMMC in the eMMC’s /boot directory. The Jetson will usually try to boot from the eMMC before switching to a different device. Study the boot sequence of the Jetson to properly understand which Image file is being used.

Special thanks to Raffaello Bonghi (https://github.com/rbonghi) for jetson_easy scripts.

Special thanks to Shreeyak (https://github.com/Shreeyak) for discussing alternatives to get source directly from NVIDIA git repositories.

Special thanks to Alexander Rashed (@alexrashed on Github) for vL4T32.1.0 release

Release Notes

January, 2020

- vL4T32.3.1

- L4T 32.3.1 (JetPack 4.3)

May, 2019

- vL4T32.1.0

- L4T 32.1.0 (JetPack 4.2)

July, 2018

- vL4T28.2.1

- L4T 28.2.1 (JetPack 3.2.1)

- Fix issue with scripts jetson_variables to determine L4T version.

** Special thanks to Shreeyak (https://github.com/Shreeyak) - Refactored scripts/getKernelSources and getKernelSourcesNoGUI

April, 2018

- vL4T28.2r3

- L4T 28.2 (JetPack 3.2)

- Add removeAllKernelSources.sh

- Add checks to make sure kernel version matches L4T release

April, 2018

- vL4T28.2r2

- L4T 28.2 (JetPack 3.2)

- Add getKernelSourcesNoGUI.sh for cases where the user does not want to edit the .config file through a GUI.

March, 2018

- vL4T28.2

- L4T 28.2 (JetPack 3.2 DP)

- Removed patches for make file cleanup

July, 2017

- vL4T28.1

- L4T 28.1 (JetPack 3.1)

March, 2017

- vL4T27.1

- L4T 27.1 (JetPack 3.0)

- Developers Preview

Vision Accelerator

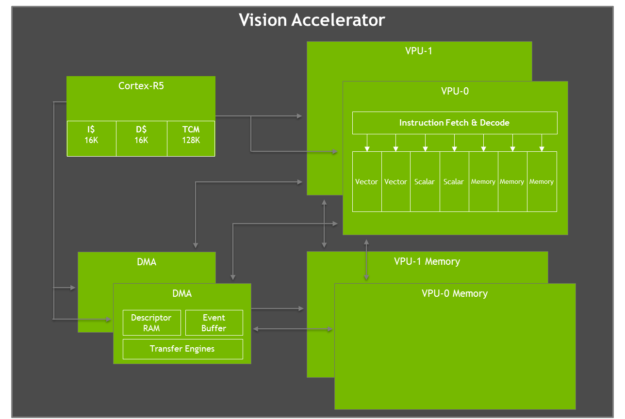

Jetson AGX Xavier features two Vision Accelerator engines, shown in figure 12. Each includes a dual 7-way VLIW (Very Long Instruction Word) vector processor that offloads computer vision algorithms such as feature detection & matching, optical flow, stereo disparity block matching, and point cloud processing with low latency and low power. Imaging filters such as convolutions, morphological operators, histogramming, colorspace conversion, and warping are also ideal for acceleration.

Figure 12. Block diagram of Jetson AGX Xavier VLIW Vision Accelerator architecture

Figure 12. Block diagram of Jetson AGX Xavier VLIW Vision Accelerator architecture

Each Vision Accelerator includes a Cortex-R5 core for command and control, two vector processing units (each with 192KB of on-chip vector memory), and two DMA units for data movement. The 7-way vector processing units contain slots for two vector, two scalar, and three memory operations per instruction. The Early Access software release lacks support for the Vision Accelerator but will be enabled in a future version of JetPack.

Installing TensorFlow

Note: As of the 20.02 TensorFlow release, the package name has changed from

tensorflow-gpu to tensorflow. See the section on

for

more information.

Install TensorFlow using the pip3 command. This command will install

the latest version of TensorFlow compatible with JetPack 4.4.

$ sudo pip3 install --pre --extra-index-url https://developer.download.nvidia.com/compute/redist/jp/v44 tensorflow

Note: TensorFlow version 2 was recently released and is not fully backward compatible

with TensorFlow 1.x. If you would prefer to use a TensorFlow 1.x package, it can be

installed by specifying the TensorFlow version to be less than 2, as in the

following

command:

$ sudo pip3 install --pre --extra-index-url https://developer.download.nvidia.com/compute/redist/jp/v44 ‘tensorflow<2’

If you want to install the latest version of TensorFlow supported by a particular version of

JetPack, issue the following command:

$ sudo pip3 install --extra-index-url https://developer.download.nvidia.com/compute/redist/jp/v$JP_VERSION tensorflow

Where:

- JP_VERSION

- The major and minor version of JetPack you are using, such as

42 for JetPack 4.2.2 or 33 for JetPack

3.3.1.

If you want to install a specific version of TensorFlow, issue the following command:

$ sudo pip3 install --extra-index-url https://developer.download.nvidia.com/compute/redist/jp/v$JP_VERSION tensorflow==$TF_VERSION+nv$NV_VERSION

Where:

- JP_VERSION

- The major and minor version of JetPack you are using, such as

42 for JetPack 4.2.2 or 33 for JetPack

3.3.1. - TF_VERSION

- The released version of TensorFlow, for example,

1.13.1. - NV_VERSION

- The monthly NVIDIA container version of TensorFlow, for example,

19.01.Note: The version of TensorFlow you are trying

to install must be supported by the version of JetPack you are using. Also, the package name may be different for older

releases.

See the TensorFlow For Jetson Platform

Release Notes for a list of some recent TensorFlow

releases with their corresponding package names, as well as NVIDIA container and JetPack compatibility.

For example, to install TensorFlow 1.13.1 as of the 19.03 release, the command would look

similar to the

following:

$ sudo pip3 install --extra-index-url https://developer.download.nvidia.com/compute/redist/jp/v42 tensorflow-gpu==1.13.1+nv19.3

If you want to have

multiple versions of TensorFlow available at the same time, this can be accomplished using

virtual environments. See below.

Set up the Virtual Environment

First, install the virtualenv package and create a new Python 3 virtual

environment:

$ sudo apt-get install virtualenv $ python3 -m virtualenv -p python3 <chosen_venv_name>

Activate the Virtual Environment

Next, activate the virtual environment:

$ source <chosen_venv_name>/bin/activate

Install the

desired version of TensorFlow and its dependencies:

$ pip3 install -U numpy grpcio absl-py py-cpuinfo psutil portpicker six mock requests gast h5py astor termcolor protobuf keras-applications keras-preprocessing wrapt google-pasta setuptools testresources $ pip3 install --extra-index-url https://developer.download.nvidia.com/compute/redist/jp/v44 tensorflow==$TF_VERSION+nv$NV_VERSION

Finally, deactivate the virtual environment:

$ deactivate

Run a Specific Version of TensorFlow

After the virtual

environment has been set up, simply activate it to have access to the specific version

of TensorFlow. Make sure to deactivate the environment after use:

$ source <chosen_venv_name>/bin/activate $ <Run the desired TensorFlow scripts> $ deactivate

Jetson Family

Jetson AGX Xavier series

Jetson AGX Xavier series modules enable new levels of compute density, power efficiency, and AI inferencing capabilities at the edge. Users can configure operating modes for their applications at 10W, 15W, or 30W with the Jetson AGX Xavier module. These modules have 10X the energy efficiency and 20X the performance of Jetson TX2.

Jetson AGX Xavier Developer Kit

Jetson AGX Xavier

Industrial version available 1H2021

Jetson Xavier NX

Jetson Xavier NX brings up to 21 TOPs of accelerated AI computing to the edge in a small form factor module. It can run multiple modern neural networks in parallel and process data from multiple high-resolution sensors—a requirement for full AI systems. Jetson Xavier NX is production-ready and supports all popular AI frameworks.

Jetson Xavier NX

Jetson TX2 series

Jetson TX2 is built around an NVIDIA Pascal-family GPU and features a variety of standard hardware interfaces that make it easy to integrate it into a wide range of products and form factors. The Jetson TX2 embedded module for edge AI applications comes in three versions: Jetson TX2, Jetson TX2i, and the lower-price Jetson TX2 4GB.

Jetson TX2 Developer Kit

Jetson TX2 4GB

Jetson TX2

Jetson TX2i

Jetson Nano

NVIDIA Jetson Nano is a small, powerful computer for embedded AI systems and IoT that delivers the power of modern AI in a low-power platform. Get started fast with the NVIDIA Jetpack SDK and a full desktop Linux environment and start exploring a new world of embedded products.

Jetson Nano Developer Kit

Jetson Nano

Jetson TX1

The world’s first supercomputer on a module, Jetson TX1 delivers the performance and power efficiency needed for visual computing applications. It’s built around the revolutionary NVIDIA Maxwell architecture with 256 CUDA cores delivering over 1 TFLOPs of performance to enable embedded deep learning, computer vision, graphics, and GPU computing systems. New designs should use Jetson TX2 4GB to run neural networks with double the compute performance or double the power efficiency of Jetson TX1—at the same price.

Jetson TX1

Serial Console Background

The story of serial data transfer over wires goes back almost a hundred years. I’ve heard stories that Ferdinand Magellan first discovered a serial cable on his journeys, but lost it to a tangle in the battle of Mactan in 1521. Apparently it was later rediscovered in America where teletypewriters used serial communication technology over telegraph wires, the first patents around stop/start method of synchronization over wires being granted around 1916.

Serial communication in the computer industry is ubiquitous, in this case we are going to connect an Ubuntu PC up to the Jetson TX2 Development Kit through UART 1 on the TX2 J21 GPIO header. UART 1 is the serial console on the Jetson TX2 which allows direct access to the serial and debug console. Quite a handy thing to have when the going gets hardcore.

Note: Because the Jetson TX1 and the Jetson TX2 use the same carrier board, the procedure is the same for both devices. There is a nearly identical version of this post for the TX1, basically because we could not afford any new jokes for this article.

Возможно, вам также будет интересно

Сегодня набирает популярность концепция пограничных вычислений: обработка данных постепенно перемещается на периферию, к устройствам IoT, которые эти данные непосредственно собирают. Следующий шаг к более эффективному анализу информации без задержек — использование искусственного интеллекта (ИИ). Поэтому вполне логичным стало появление гибрида «Интернета вещей» и ИИ, получившего название AIoT (…

Основное назначение систем железнодорожной автоматики и телемеханики — обеспечение безопасности движения поездов, поскольку сбой или отказ таких систем на станции или перегоне может привести к катастрофическим последствиям, в том числе к многочисленным человеческим жертвам. Современная практика показала, что релейные, механические, релейно-процессорные системы имеют ряд недостатков. Внедрение м…

Передовые разработки в области кондуктивного охлаждения позволяют выйти за пределы существующих технологических ограничений и не только повысить мощность охлаждения, но и сделать конструкцию устройства более удобной в эксплуатации.

Setup and First Boot

Setup Steps

- Unfold the paper stand and place inside the developer kit box.

- Set the developer kit on top of the paper stand.

- Insert the microSD card (with system image already written to it) into the slot on the underside of the Jetson Nano module.

- Power on your computer display and connect it.

- Connect the USB keyboard and mouse.

- Connect your Micro-USB power supply (5V⎓2A). The Jetson Nano Developer Kit will power on and boot automatically.

First Boot

A green LED next to the Micro-USB connector will light as soon as the developer kit powers on. When you boot the first time, the Jetson Nano Developer Kit will take you through some initial setup, including:

- Review and accept NVIDIA Jetson software EULA

- Select system language, keyboard layout, and time zone

- Create username, password, and computer name

- Log in

Getting Started with the Jetson TX2 Developer Kit

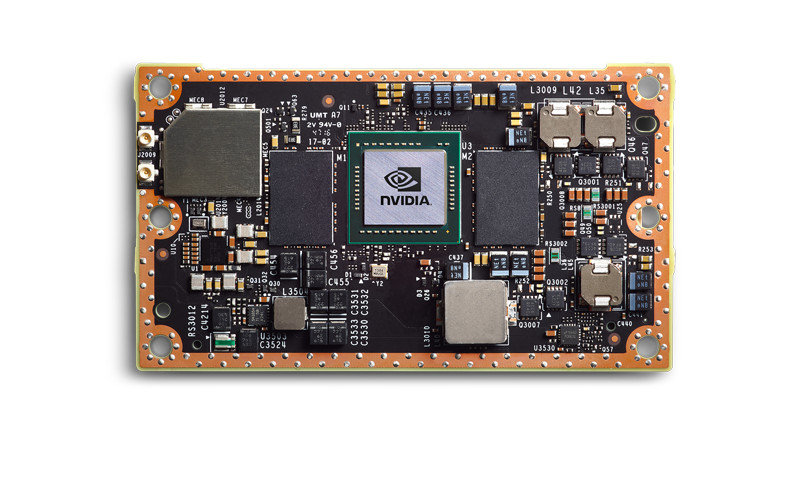

To get started, NVIDIA provides the Jetson TX2 Developer Kit complete with a reference mini-ITX carrier board (170 mm x 170mm) and a 5-megapixel MIPI CSI-2 camera module. The Developer Kit includes documentation and design schematics and free software updates to JetPack-L4T. Figure 5 pictures the Developer Kit, showing the Jetson TX2 module and standard PC connections including USB3, HDMI, RJ45 Gigabit Ethernet, SD card, and a PCIe x4 slot, which make it easy to develop applications for Jetson.

Figure 5: NVIDIA Jetson TX2 Developer Kit including module, reference carrier, and camera module.

To move beyond development to custom deployed platforms, you can modify the reference design files for the Developer Kit carrier board and camera module to create a custom design. Alternatively, Jetson ecosystem partners offer off-the-shelf solutions for deploying Jetson TX1 and Jetson TX2 modules, including miniature carriers, enclosures, and cameras. The NVIDIA Developer Forums offer technical support and a home for collaboration with the community of Jetson builders and NVIDIA engineers. Table 3 lists principal documentation and helpful resources.

| Embedded Developer Portal : developer.nvidia.com/embedded | |

|---|---|

| Jetson TX2 Module Datasheet | Jetson TX2 OEM Design Guide |

| Jetson TX2 Thermal Design Guide | Jetson Developer Kit Carrier Specification |

| Jetson TX1-TX2 Interface Comparison and Migration | Jetson Developer Kit Carrier Design Files |

| L4T Accelerated GStreamer Guide | Jetson Camera Module Design Guide |

| Jetson TX2 Developer Forums | Jetson TX2 Wiki – eLinux.org/Jetson_TX2 |

The Jetson TX2 Developer Kit is available for preorder for $599 through the NVIDIA Online Store. Shipments begin March 14 in North America and Europe, with other regions to follow. The Jetson TX2 Education Discount is also available: $299 for affiliates of academic institutions. NVIDIA has reduced the price of the Jetson TX1 Developer Kit to $499.

JetPack 3.0 SDK

The latest NVIDIA JetPack 3.0 enables Jetson TX2 with industry-leading AI developer tools and hardware-accelerated API’s (see table 4) including the NVIDIA CUDA Toolkit version 8.0, cuDNN, TensorRT, VisionWorks, GStreamer, and OpenCV, built on top of the Linux kernel v4.4, L4T R27.1 BSP, and Ubuntu 16.04 LTS. Jetpack 3.0 includes the Tegra System Profiler and Tegra Graphics Debugger tools for interactive profiling and debugging. The Tegra Multimedia API includes low-level camera capture and Video4Linux2 (V4L2) codec interfaces. While flashing, JetPack automatically configures Jetson TX2 with the selected software components, enabling a complete environment out of the box.

Jetson is the high-performance embedded solution for deploying deep learning frameworks like Caffe, Torch, Theano, and TensorFlow. These and numerous other deep learning frameworks already integrate NVIDIA’s cuDNN library with GPU acceleration and require minimal migration effort to deploy on Jetson. Jetson adopts NVIDIA’s shared software and hardware architecture typically found in PC and server environments to seamlessly scale and deploy applications across the enterprise from the cloud and datacenter to devices at the edge.

Сферы применения модулей семейства Jetson

Сельское хозяйство — одна из самых консервативных сфер, но применение средств ИИ в ней имеет огромный потенциал. Одна из компаний, Blue River, уже давно представила свою технологию для точечной доставки удобрений строго на те растения, которые необходимо опрыскивать. К примеру, нужно избавиться от сорняков, не тронув культурные растения, — для этого система See & Spray, имеющая вид прицепного устройства к трактору, при проходе по полю снимает его поверхность, а ИИ-система на основе Jetson определяет участки для опрыскивания и прицельно наносит на них удобрения. Химикатов в почву при таком подходе заносится минимальное количество, и делается это исключительно адресно — маленькими дозами и прямо по сорнякам.

Системы на базе Jetson применяются и в других сферах. В частности, их используют российские производители камер видеофиксации нарушений ПДД. Такие камеры, благодаря расширению возможностей решений NVIDIA, уже «научились» не только быстро распознавать номера автомобилей, но и отслеживать гораздо большее количество нарушений, связанных с дорожной разметкой и знаками.

Еще один пример использования систем с ИИ — «умные» сетевые видеорегистраторы, требующие обработки потоков информации с многочисленных камер. Сейчас они чаще всего просто записывают данные с камер и, как максимум, улавливают появление движения в кадре. Особого интеллекта в таких видеорегистраторах нет, хотя это и востребовано клиентами, но до последнего времени внедрять ИИ в такие устройства было слишком дорого. Jetson Nano за счет низкой цены и миниатюрности хорошо подходит для таких решений.

Самый простой и бюджетный вариант видеорегистратора на основе Nano способен одновременно обрабатывать изображения с восьми камер в Full HD-разрешении при 30 FPS, распознавая заданные объекты (людей, автомобили и др.), а также обеспечивать скорость обработки более 40 изображений в секунду при распознавании обученной нейросетью ResNet50. Система подороже — на Jetson TX2 — обрабатывает уже 16 таких потоков, при этом скорость распознавания объектов составляет под 100 изображений в секунду. В свою очередь, самый продвинутый регистратор на Jetson AGX Xavier справится уже с 64 видеопотоками в Full HD или 16 потоками 4K-разрешения, а распознавание изображений нейросетью ResNet50 будет осуществляться на скорости почти в 2000 изображений в секунду.

Аналогичные задачи стоят и перед системами «умных городов»: распознаванием лиц, пола, возраста и даже человеческих эмоций в ближайшие годы займутся сотни тысяч «умных» камер, и для внедрения таких технологий решения семейства Jetson и предназначены.

В целом, применять модули компании можно в самых разных устройствах, вплоть до сложных промышленных роботов. Сама NVIDIA разработала Jetbot — платформу для создания роботов с открытым кодом, использующую Jetson Nano в качестве аппаратной части. Она позволяет собрать действующего робота, который программируется через браузер. На github выложен список составных частей, которые нужно приобрести дополнительно (камера, мотор, батарея, SD-карта и т. п.), и чертежи для создания тележки для печати на 3D-принтере. Даже человек, мало что знающий про ИИ, может собрать за несколько дней автономного робота, который будет интеллектуальнее всех «умных» роботов-пылесосов, продающихся на рынке. Также у NVIDIA есть краткий вебинар по созданию программного стека для работы Jetbot. Эта открытая инициатива компании хорошо подойдет начинающим разработчикам, студентам и школьникам. Работать с Jetson достаточно просто, нужно приобрести комплект разработчика и скачать с сайта компании программную часть. Даже инженер без особого опыта работы с глубоким обучением в итоге сможет получить рабочую нейросеть.

Затем можно продолжать изучение темы по лабораторным работам Deep Learning Institute и конференциям GTC, экспериментировать с устройством, превратив свою конструкцию в нечто совершенно иное, хоть даже и передвижное мусорное ведро, следующее за своим хозяином (это, конечно, шутка, а вот «умные» селфи-дроны — нет). И все это — за пару десятков тысяч рублей и несколько строчек кода. Если же конструкции не требуется возможность автономного передвижения, то за те же деньги можно сделать полноценную систему распознавания лиц для своей квартиры или анализ поведения покупателей в магазине. Простейшие системы, отслеживающие и запоминающие людей, не потребуют даже написания сложного кода — можно воспользоваться имеющимися примерами.

Prepare for Setup

microSD Card

The Jetson Nano Developer Kit uses a microSD card as a boot device and for main storage. It’s important to have a card that’s fast and large enough for your projects; the minimum recommended is a 16GB UHS-1 card.

See the instructions below to flash your microSD card with operating system and software.

Micro-USB Power Supply

You’ll need to power the developer kit with a good quality power supply that can deliver 5V⎓2A at the developer kit’s Micro-USB port. Not every power supply rated at “5V⎓2A” will actually do this.

As an example of a good power supply, NVIDIA has validated Adafruit’s 5V 2.5A Switching Power Supply with 20AWG MicroUSB Cable (GEO151UB-6025). It was specifically designed to overcome common problems with USB power supplies; see the linked product page for details.

Note

The stated power output capability of a USB power supply can be seen on its label.

Actual power delivery capabilities of USB power supplies do vary. Please see the Jetson Nano Developer Kit User Guide for additional information.

Click or tap image for closeup.

Jetson TX2i Module

Jetson TX2 Developer Kit

What’s Included

- mini-ITX Reference carrier board

- Jetson TX2 Module

- 5MP CSI camera module (with Omnivision OV5693)

- WiFi/BT antennas

- USB OTG adapter

- 19VDC Power brick

- AC Power cable

The design files for the reference carrier board and camera module are freely available for .

Getting Started

- Get the latest development software for PC and TX2 by using .

- Plug in an HDMI display into Jetson, attach the antennas and USB keyboard & mouse, and apply power to boot it up. ()

- Visit the and to access the latest documentation & downloads.

Availability

- The devkit is available through NVIDIA’s webpage.

- The individual module is available through NVIDIA’s webpage.

- There’s also an available for those affiliated with an educational organization.

Platform Documentation

- the official module features, ports, signal pin-out, and package specifications.

- detailed technical design and layout information for creating OEM products.

- design info about the reference carrier board from the devkit.

- schematics, layout, and design files for the devkit reference carrier board.

- 3D STEP file for reference carrier board, heatsink, camera board, and module.

- schematics, layout, and design files for the devkit MIPI CSI-2 camera module.

- mechanical specifications for designing active and passive cooling solutions.

- guide to porting applications and hardware between Jetson TX1 and TX2

- document for the design of battery charger

- Technical Reference Manual for NVIDIA TX2 system-on-chip and register data.

- documentation for L4T kernel developers (including V4L2/camera drivers).

- documentation to Argus camera API and V4L2 media codecs

- example gstreamer pipelines for accessing H.264/H.265 hardware video codec.

Above is a partial list of documents.

Please visit the at Embedded Developer Zone for the full list that’s currently available.

Guides and Tutorials

This section contains recipes for following along on Jetson.

System Tools

-

- Cloning & Restore

- BSP FAQ

- Setting the DTB

- Enabling the SPI Port

- Enabling USB on Custom Carriers

- Maximizing RootFS Partition on eMMC

- Display Driver Debugging r28

V4L2 drivers for cameras

RidgeRun has a list of drivers already supported in Jetson, please check if the driver that you need is already there. Otherwise, RidgeRun offers services to create the driver for you

Design FAQs

There are some useful FAQs for Jetson TX2 design, link is here.

Ecosystem Products

The following are 3rd-party carriers, enclosures, expansion boards, and accessories available for Jetson TX2.

Please see additional backwards-compatible .

Cameras

-

- Allied Vision USB3 Vision

- DCDZ(冬虫电子) XCB-OV5640 OV5640 M12 lens camera

- DCDZ(冬虫电子) XCB-OV5693 OV5693 camera

- DCDZ(冬虫电子) XCB-H2C HDMI to CSI2 board

- DCDZ(冬虫电子) XCB-H2C4K HDMI to CSI2 4K board

- DCDZ(冬虫电子) XCB-SDI SDI to CSI2 board

- DCDZ(冬虫电子) XCB-8eyes 4 or 8 cameras ADAS expansion board

If you have a technical question or bug report, please visit the and search or start a topic.

Мобильники

- Существует очень много аппаратных ускорителей на которых можно оптимизировать нейронки.

- Не существует общего решения которое хорошо зайдёт везде. Сейчас есть какая-то попытка сделать Tensorflow lite таким решением. Но, как я понимаю, оно пока им не стало.

- У некоторых производителей есть свои специальные ферймворки. Мы год назад помогали оптимизировать под Snapdragon фреймворк. И это было ужасно. Качество нейронок там сильно ниже чем на всём о чём я сегодня говорил. Отсутствует поддержка 90% слоёв, даже базовых, таких как “сложение”.

- Так как нет питона — инференс сетей весьма странный, нелогичный и неудобный.

- По производительности — бывает что всё очень неплохо (например на каком-нибудь iphone).

Technical Comparison

| Jetson Nano | Jetson TX2 | |

|---|---|---|

| AI Performance | 472 GFLOPs | 1.3 TFLOPs |

| GPU | 128-core NVIDIA Maxwell GPU | 256-core NVIDIA Pascal GPU |

| CPU | Quad-Core ARM Cortex-A57 MPCore | Dual-Core NVIDIA Denver 2 64-Bit CPU and Quad-Core ARM Cortex-A57 MPCore |

| Memory | 4GB 64-bit LPDDR4 Memory | 8GB 128-bit LPDDR4 Memory |

| Storage | Micro SD card slot | 32GB eMMC 5.1 |

| Video | Encode: 4K @ 30 (H.264/H.265) Decode: 4K @ 60 (H.264/H.265) |

Encode: 4K x 2K 60 Hz (HEVC) Decode: 4K x 2K 60 Hz (12-bit support) |

| Connectivity | Gigabit Ethernet | Gigabit Ethernet, WiFi, Bluetooth |

| CSI | 12x CSI-2 D-PHY 1.1 (Up to 18 GB/s) | 12x CSI-2 D-PHY 1.2 (Up to 30 GB/s) |

| Display | Two Multi-Mode DP 1.2 eDP 1.4 HDMI 2.0 1×2 DSI (1.5Gbps/lane) |

Two Multi-Mode DP 1.2 eDP 1.4 HDMI 2.0 Two 1×4 DSI (1.5Gbps/lane) |

| PCIE | Gen 2 | 1×4 | Gen 2 | 1×4 + 1×1 OR 2×1 + 1×2 |

| Power | 5W / 10W | 7.5W / 15W |

Intelligent Video Analytics (IVA)

AI and deep learning enables vast amounts of data to be effectively utilized for keeping cities safer and more convenient, including applications such as traffic management, smart parking, and streamlined checkout experiences in retail stores. NVIDIA Jetson and NVIDIA DeepStream SDK enables distributed smart cameras to perform intelligent video analytics at the edge in real time, reducing the massive bandwidth loads placed on transmission infrastructure and improving security along with anonymity.

Video capture of IVA demo running on Jetson AGX Xavier with 30 concurrent HD streams

Jetson TX2 could process two HD streams concurrently with object detection and tracking. As shown in the video above, Jetson AGX Xavier is able to handle 30 independent HD video streams simultaneously at 1080p30 — a 15x improvement. Jetson AGX Xavier offers a total throughput of over 1850MP/s, enabling it to decode, pre-process, perform inferencing with ResNet-based detection, and visualize each frame in just over 1 millisecond. The capabilities of Jetson AGX Xavier bring greatly increased levels of performance and scalability to edge video analytics.

RaspberryPI 4

отсюдатут

- Как бы не хотелось, это не продуктовое решение. Перегревы. Периодические зависания. Но за счёт огромного комьюнити на каждую проблему есть сотни решений. Это не делает Rpi хорошим для тысячных тиражей. Но десятки/сотни — вай нот.

- Скорость. Это самое медленное устройство из всех основных про которые мы говорим.

- Поддержка от производителя почти отсутствует. Товар ориентирован на энтузиастов.

- Цена. Нет, конечно, если вы сами разводите плату, то используя gyrfalcone вы может быть сможете сделать дешевле на партиях в тысячи. Но скорее всего это нереально. Там где производительности RPi хватает — это будет самое дешёвое решение.

- Популярность. Когда вышел Caffe2, то в базовом релизе была версия под Rpi. Tensorflow light? Конечно работает. И.т.д., и.т.п. Что не делает производитель — переносят пользователи. Я запускал на разных RPi и Caffe и Tensorflow и PyTorch, и кучу более редких вещей.

- Удобство для маленьких партий/штучных изделий. Просто прошить флешку и запустить. Есть WiFi на борту, в отличие от JetsonNano. Можно просто через PoE запитать (вроде там нужно докупить переходник, которые продаются активно).

Преимущества платформы NVIDIA для ИИ

Платформа NVIDIA покрывает все решения компании, от суперкомпьютеров для дата-центров до автономных устройств Jetson. Открытой платформой для разработки уже пользуется несколько сотен тысяч разработчиков: инструментарий для компактных Jetson мало отличается от того, что есть для привычных настольных GPU. Однако преимущество решений NVIDIA в том, что все они поддерживают CUDA и перенос кода или части вычислений с одного устройства на другое не вызовет никаких трудностей. Можно обучать модели в высокопроизводительных дата-центрах на Tesla, а внедрять их на компактных Jetson.

Миграция задачи с устройства на устройство происходит очень просто и бесшовно, поскольку базовая архитектура CUDA используется во всех продуктах компании, от Tesla/DGX для дата-центров до Jetson в компактных автономных устройствах. Все эти устройства различаются по производительности и функциональности, но с точки зрения программирования и удобства работы между ними разницы нет. И если у разработчика есть опыт работы с GPU, то он сможет заниматься и дата-центрами, и автономными устройствами.

Хотя NVIDIA традиционно считается компанией, производящей аппаратное обеспечение, она создает и программную часть. Специалисты компании разработали полноценный программный стек для автономных решений (рис. 4): в низкоуровневой его части лежит поддержка CUDA и Jetpack SDK для тех, кто хочет иметь прямой доступ к вычислениям, графическим ядрам, сенсорам и т. п., а за более высокий уровень отвечают модули, разработанные как самой компанией, так и ее партнерами. Эти модули помогают решать задачи тем, кто не хочет или не может заниматься низкоуровневым программированием, — им доступны такие аппаратно-ускоренные возможности, как определение глубины сцены, распознавание объектов, поз и жестов, планирование траекторий, распознавание голосового ввода и др.

Рис. 4. Единый программный стек для решений на базе модулей NVIDIA Jetson

NVIDIA поощряет разработку сторонних модулей, не имеющих к компании никакого отношения. В качестве примера можно привести компанию Fastvideo, известную обработкой изображений. Они работают с низкоуровневым слоем экосистемы NVIDIA, а сторонние компании могут использовать готовые библиотеки их разработки, оптимизированные для аппаратной части NVIDIA.

Среди ПО NVIDIA существует также Deepstream SDK — часть программной платформы для анализа данных с камер и сенсоров в реальном времени, использующая аппаратное ускорение. SDK создан не только для Jetson, но и для других решений NVIDIA: он позволяет реализовать рабочий процесс, связанный с видеоаналитикой, — захват изображения, распознавание образов, накопление и хранение видео и т. д. Программная инфраструктура постоянно развивается, и за последние три года поддерживаемая Jetpack версия CUDA изменилась с 7.0 до 10, TensorRT — с 1.0 до 5.0, Deepstream — до 3.0, а Ubuntu — с 14.04 до 18.04. В более новом ПО не только исправляют ошибки и улучшают производительность, но и добавляют новую функциональность.

В этом заключается основное преимущество линейки NVIDIA Jetson — они позволяют создавать программно определяемые системы, использующие модели глубокого обучения с аппаратным ускорением. Специалисты NVIDIA считают, что все устройства должны быть не узкоспециализированными, а настраиваемыми — чтобы изменением лишь программной части можно было дополнить и улучшить функциональность устройства в целом. При этом разработчики могут ориентироваться на разный бюджет: если Xavier потребуется для решения самых сложных задач, то тот же Nano позволит недорого получить производительность, вполне достаточную для анализа нескольких видеопотоков одновременно. Все эти устройства используют одно и то же ПО, и только за счет смены аппаратного решения можно получить прирост производительности и расширение возможностей, без необходимости переделывать программный код.